OpenAI ebnet mit dem ChatGPT Advanced Voice Mode den Weg für realistische Gespräche mit Chatbots. Das Unternehmen ermöglicht es uns, mit KI wie mit einem Menschen zu korrespondieren und nun wie mit einem Menschen mit ihr zu sprechen. Werfen wir einen Blick auf den ChatGPT Advanced Voice Mode, der derzeit nur einer begrenzten Anzahl von Plus-Mitgliedern zur Verfügung steht.

Dieses hochmoderne Feature, das unsere Interaktion mit KI revolutionieren wird, löst eine Debatte aus, die fast so interessant ist wie die Technologie selbst. Hey, Jarvis, bist du da?

Wir beginnen damit, den erweiterten Sprachmodus für eine kleine Gruppe von ChatGPT Plus-Benutzern einzuführen. Der erweiterte Sprachmodus bietet natürlichere Gespräche in Echtzeit, ermöglicht es Ihnen, jederzeit zu unterbrechen, und erkennt und reagiert auf Ihre Emotionen. pic.twitter.com/64O94EhhXK

— OpenAI (@OpenAI) 30. Juli 2024

ChatGPT Erweiterter Sprachmodus: Mehr als nur reden

Das neueste Produkt von OpenAI ist kein gewöhnliches Sprachassistent. Der ChatGPT Advanced Voice Mode soll hyperrealistische Sprachantworten bieten, die die Grenze zwischen Mensch und KI verwischen. Im Gegensatz zu seinem Vorgänger, der auf drei separate Modelle zur Verarbeitung von Spracheingaben angewiesen war, ist GPT-4o (die Engine hinter dieser neuen Funktion) in der Lage, multimodale Aufgaben in einem zu erledigen. Stellen Sie sich eine Maschine vor, die die Konvertierung von Sprache in Text, die Eingabeaufforderungsverarbeitung und die Ausgabe von Text in Sprache in einem Rutsch bewältigen kann. Fließende Gespräche, die Sie vergessen lassen, dass Sie sich mit einem Roboter unterhalten, sind nicht mehr weit entfernt.

Aber warten Sie, es gibt noch mehr! Diese KI-Chatbox behauptet, emotionale Intonationen erkennen zu können; sie kann erkennen, ob Sie traurig oder aufgeregt sind. Sie kann sogar mit Ihnen Karaoke singen – erwarten Sie jedoch nicht, dass sie urheberrechtlich geschützte Lieder singt. Sehen wir uns zunächst an, wie der erweiterte Sprachmodus von ChatGPT verwendet wird.

So verwenden Sie den erweiterten Sprachmodus von ChatGPT

Bereit, Ihren Fingern eine Pause zu gönnen und Ihre Stimmbänder zu trainieren? Hier erfahren Sie, wie Sie mit der neuesten Kreation von OpenAI ins Gespräch kommen. Der ChatGPT Advanced Voice Mode ist derzeit für eine begrenzte Anzahl von ChatGPT Plus-Benutzer (also hat nicht jedes Plus-Mitglied Zugriff darauf)aber nur, wenn Sie dazu gehören:

- Aktualisieren Sie Ihre App: Stellen Sie zunächst sicher, dass Sie die neueste Version der ChatGPT-App verwenden. Für Android-Benutzer ist dies Version 1.2024.206 oder höher. Für iOS-Benutzer benötigen Sie Version 1.2024.205 oder höher und auf Ihrem Gerät muss iOS 16.4 oder höher ausgeführt werden. Auf dieser futuristischen Party ist keine alte Technologie erlaubt!

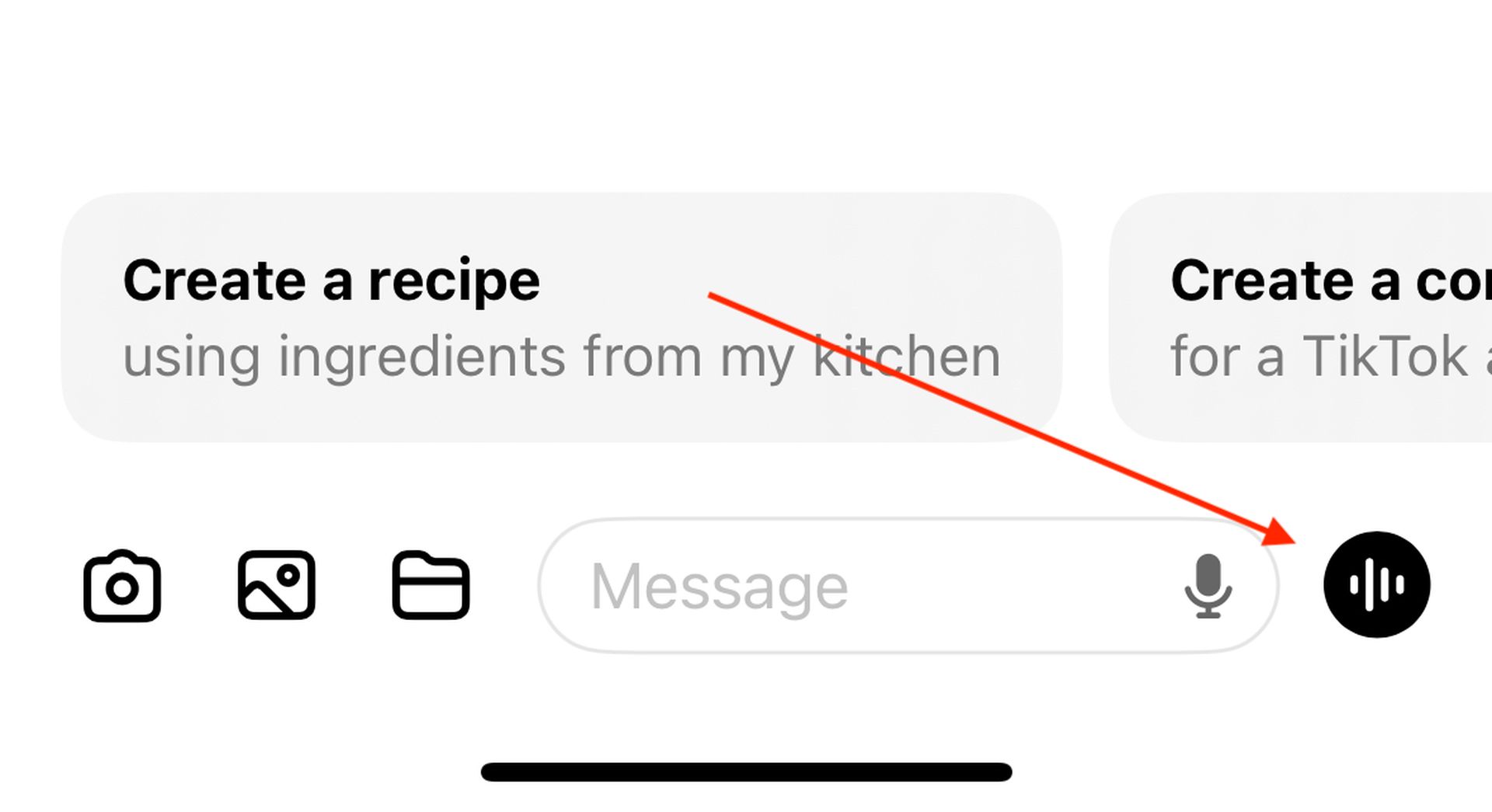

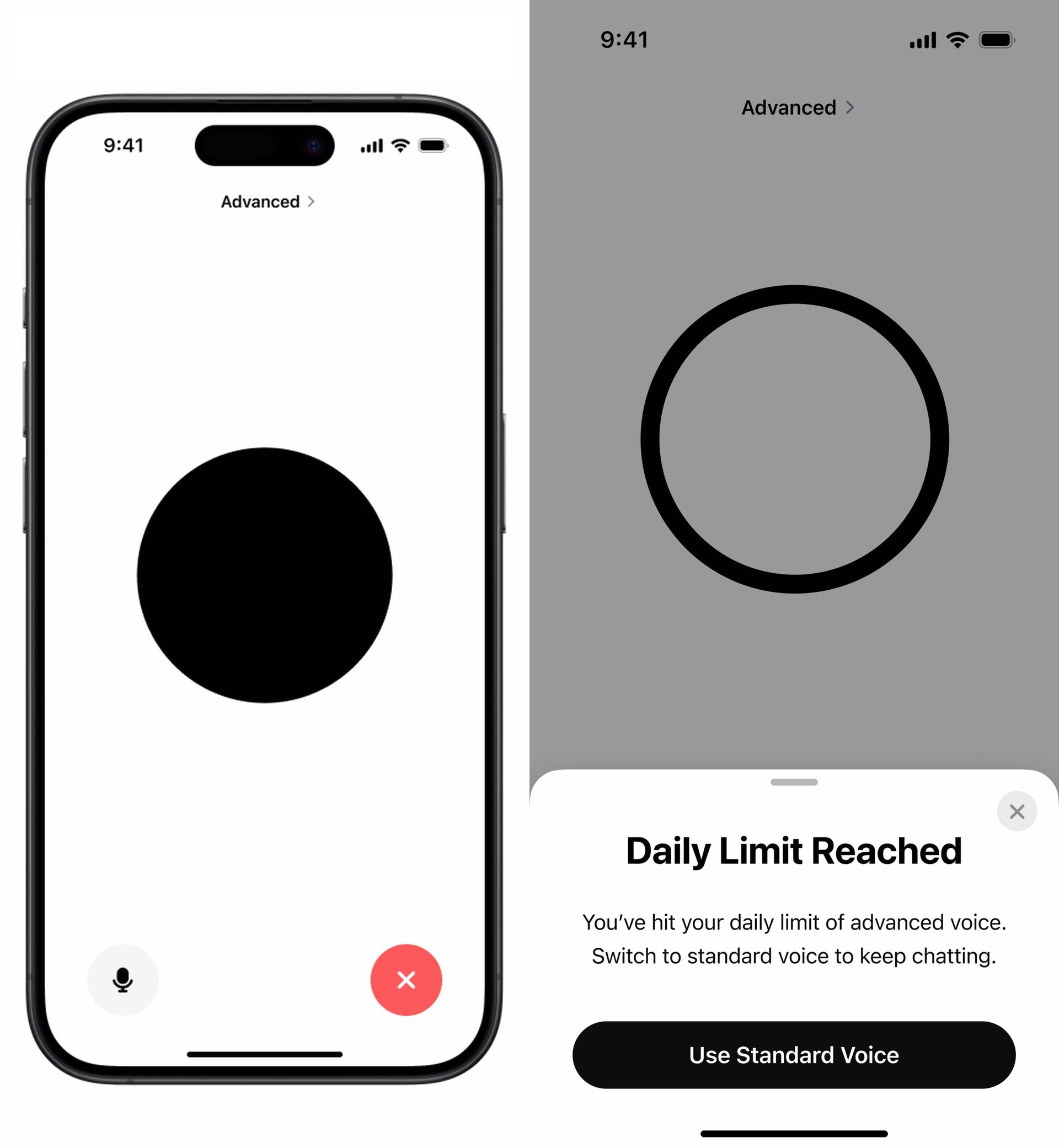

- Finden Sie Ihre Stimme: Sobald Sie alle Updates abgeschlossen haben, suchen Sie nach dem Sprachsymbol in der unteren rechten Ecke Ihres Bildschirms. Tippen Sie darauf und schon kann es losgehen.

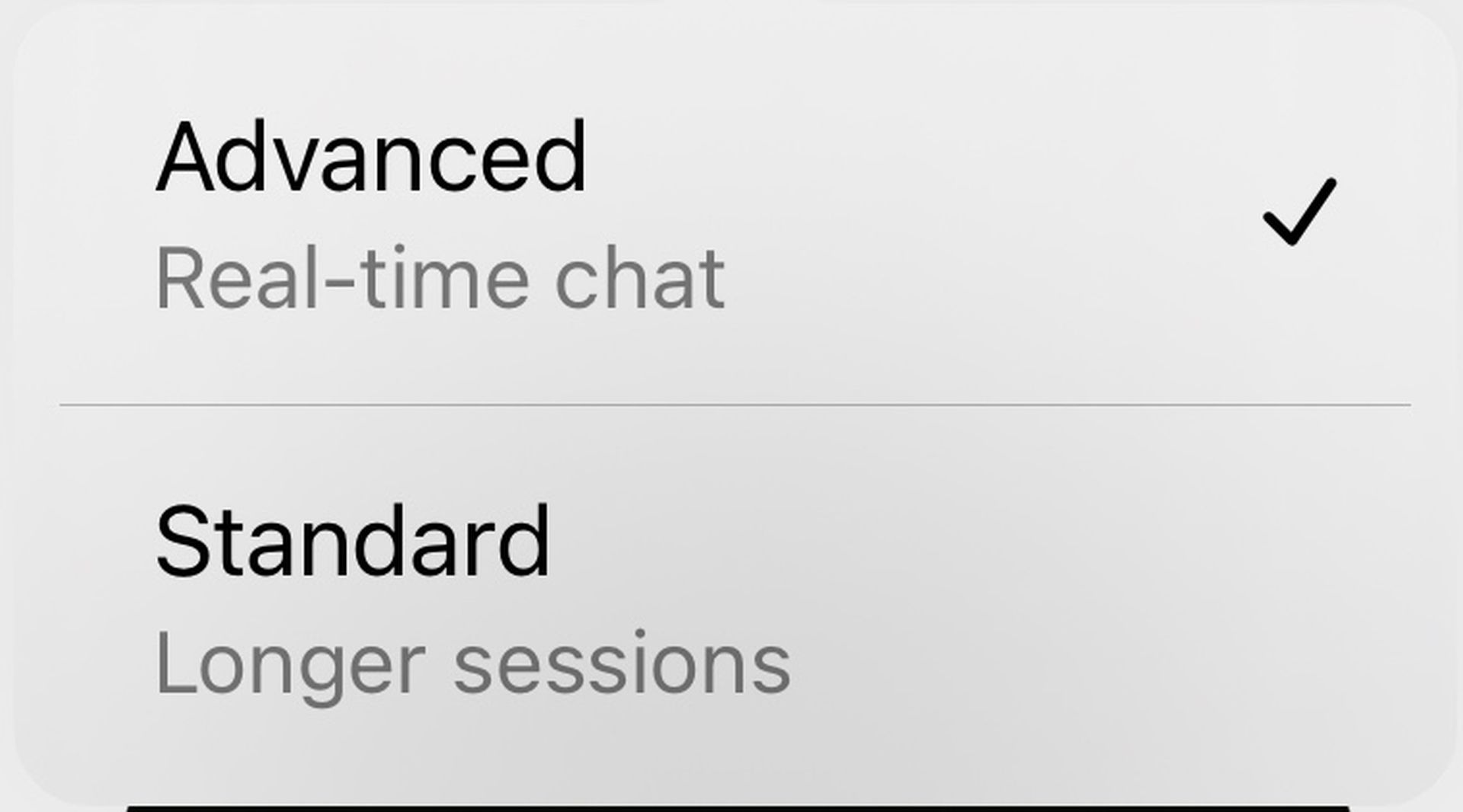

- Wähle deinen Kämpfer: Sie haben die Wahl zwischen dem Standard-Sprachmodus und dem brandneuen erweiterten Sprachmodus. Wählen Sie „Erweitert“, um die volle Leistung von GPT-4o zu erleben.

- Sprechen Sie: Ihr Mikrofon sollte standardmäßig eingeschaltet sein. Wenn Sie jedoch nicht hören möchten, überprüfen Sie das Mikrofonsymbol unten links auf dem Bildschirm. Tippen Sie zum Wechseln, falls erforderlich.

- Verplaudern: Sprechen Sie mit Ihrem KI-Freund so natürlich wie mit einem menschlichen Freund. Denken Sie daran, dass er Ihre Emotionen verstehen kann, also können Sie Ihre Persönlichkeit durchscheinen lassen.

- Wickeln Sie es: Wenn Sie mit der Beeinflussung Ihres neuen KI-Sprechers fertig sind (oder sich von ihm beeinflussen lassen), drücken Sie auf das rote Symbol unten rechts, um das Gespräch zu beenden.

Profi-Tipp: Für das beste Erlebnis sollten Sie Kopfhörer verwenden. Und iPhone-Benutzer aktivieren Sprachisolierung Mikrofonmodus, um unerwünschte Unterbrechungen zu vermeiden. Schließlich sind drei schon eine Menge, wenn Sie ein vertrauliches Gespräch mit Ihrem KI-Assistenten führen möchten!

Denken Sie daran, dass sich diese Funktion noch in der Alpha-Phase befindet und daher möglicherweise noch einige Macken hat. Aber hey, auch Menschen sind nicht immer perfekte Gesprächspartner, oder?

Scarlett Johansson: Eine kontroverse Stimme

Während OpenAI mit den erweiterten Funktionen seiner neuen Sprachfunktion ChatGPT Advanced Voice Mode prahlt, war der Weg zu ihrer Veröffentlichung nicht ohne Hindernisse. Erinnern Sie sich an die atemberaubende Demo im Mai? Es stellt sich heraus, dass eine der Stimmen, Sky, eine unheimliche Ähnlichkeit mit einem Hollywood-Star.

Scarlett Johansson, auch bekannt durch ihre Rolle als KI-Assistentin im Film „Her“, lehnte Berichten zufolge mehrere Anfragen von OpenAI-CEO Sam Altman ab, ihre Stimme zu verwenden. Johansson war schneller dabei, sich für das einzusetzen, was man als „künstliche Intelligenz“ bezeichnen könnte, als eine Demo mit einer Stimme veröffentlicht wurde, die ihrer eigenen verdächtig ähnlich klang. OpenAI bestritt, ihre Stimme verwendet zu haben, entfernte das umstrittene Sample jedoch sofort aus seinem Programm.

Sicherheit geht vor, Starlets erst danach

Als Reaktion auf die Kontroverse hat OpenAI die Veröffentlichung verzögert und sich die Zeit genommen, die Sicherheitsmaßnahmen zu erhöhen. Das Unternehmen behauptet, GPT-4o mit mehr als 100 externen Red-Team-Mitgliedern getestet zu haben, die 45 verschiedene Sprachen sprechen. Das Ergebnis. In Zusammenarbeit mit bezahlten Synchronsprechern wurde ein sichereres System mit vier voreingestellten Stimmen – Juniper, Breeze, Cove und Ember – erstellt.

OpenAI-Sprecherin Lindsay McCallum versichert, dass ChatGPT „die Stimmen anderer, weder von Privatpersonen noch von Persönlichkeiten des öffentlichen Lebens, nicht nachahmen kann und Ausgaben blockiert, die von einer dieser voreingestellten Stimmen abweichen.“ Wenn Sie also gehofft haben, mit einer virtuellen Scarlett Johansson zu chatten, haben Sie Pech gehabt.

Während OpenAI den ChatGPT Advanced Voice Mode schrittweise einführt, um alle Plus Benutzer in diesem HerbstDie Tech-Welt schaut mit angehaltenem Atem zu. Wird dies die Konversations-KI sein, auf die wir alle gewartet haben, oder wird sie in der laufenden Debatte über KI-Ethik und Urheberrechtsfragen ein neues Fass ohne Boden öffnen?

Bildnachweis: X / OpenAI Bearbeiten: Furkan Demirkaya

Source: ChatGPT Erweiterter Sprachmodus: Lässt Scarlett die Stimme vergessen