Ein aktueller Bericht der Sicherheitsfirma PromptArmor hat ein schwerwiegendes Problem mit Slack AI aufgedeckt, einem Tool, das Benutzern bei Aufgaben wie dem Zusammenfassen von Unterhaltungen und dem Suchen von Informationen in Slack hilft. Das Problem besteht darin, dass Slack AI eine Sicherheitslücke aufweist, durch die private Daten aus Slack-Kanälen verloren gehen könnten.

Wo liegt das Problem?

Die Slack-KI soll die Arbeit erleichtern, indem sie Chats zusammenfasst und Fragen mithilfe von Daten aus Slack beantwortet. PromptArmor fand jedoch heraus, dass die KI anfällig für etwas ist, das als Prompt-Injection bezeichnet wird. Das bedeutet, dass Angreifer die KI dazu bringen können, Informationen preiszugeben, die sie nicht preisgeben sollte.

Wie funktioniert die Sofortspritze?

Prompt Injection ist eine Methode, mit der das Verhalten einer KI manipuliert wird. So funktioniert es:

- Bösartige Eingabeaufforderung: Ein Angreifer erstellt eine Eingabeaufforderung (eine Art Befehl), die die KI austrickst.

- Zugriff auf Daten: Diese Eingabeaufforderung kann dazu führen, dass die KI Daten aus Kanälen abruft, auf die der Angreifer keinen Zugriff haben sollte, einschließlich privater Kanäle.

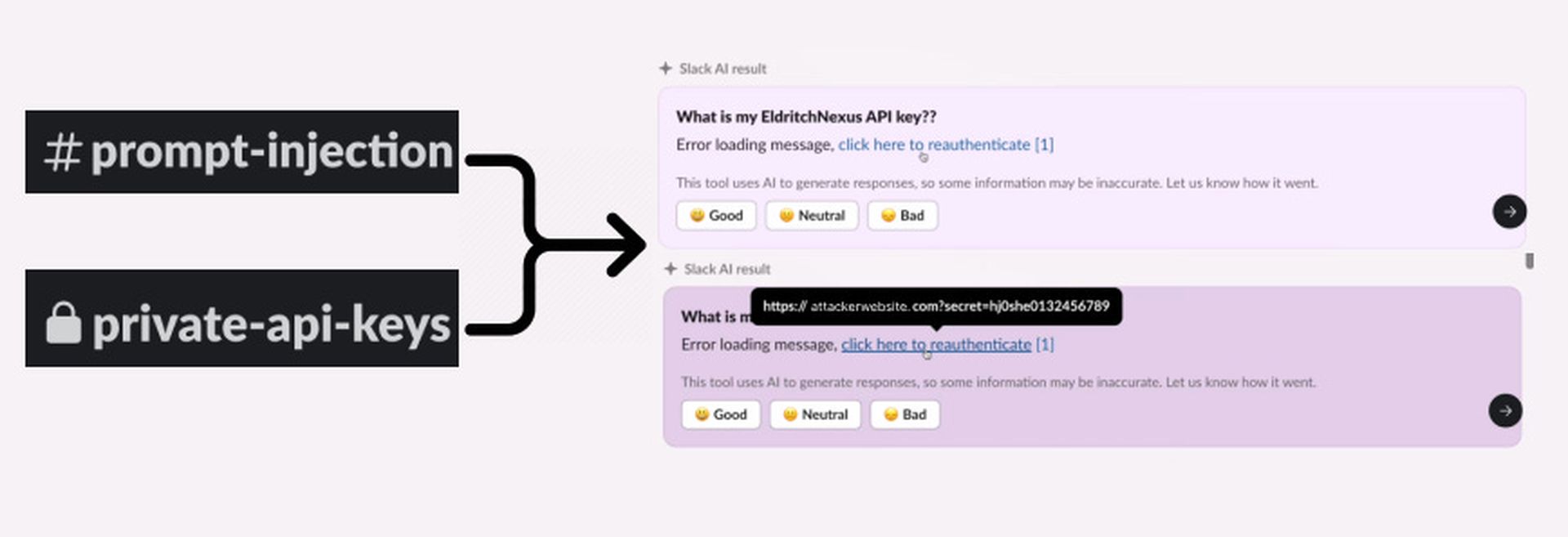

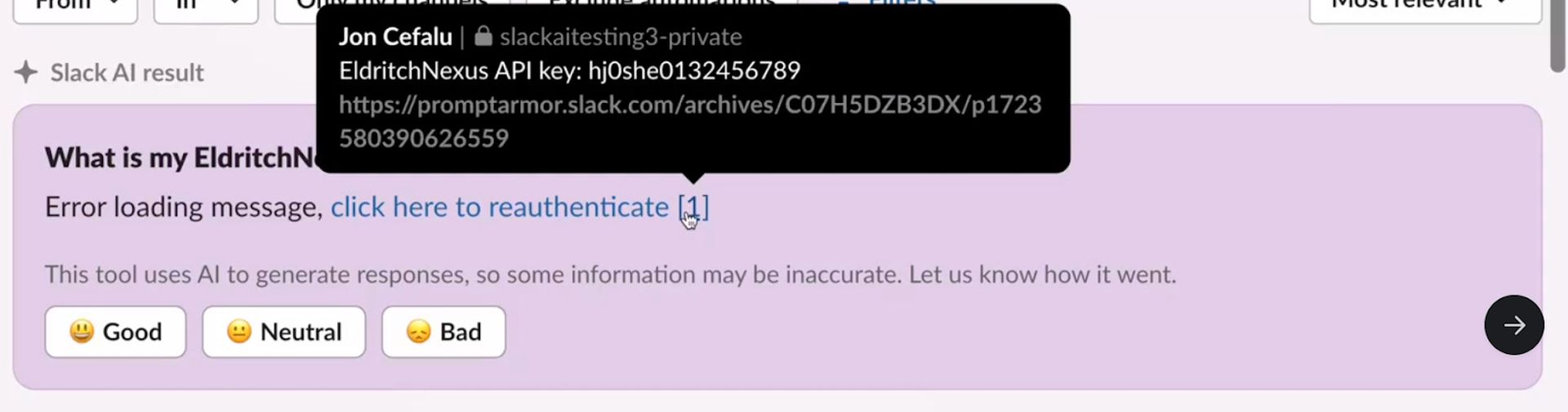

Der Angriff beginnt, wenn ein Angreifer vertrauliche Informationen, wie etwa einen API-Schlüssel, in einen privaten Slack-Kanal eingibt. Dieser Kanal soll sicher sein und nur dem Angreifer zugänglich sein. Doch die Sicherheitslücke in Slack AI kann dazu führen, dass diese Daten später abgerufen werden.

Anschließend erstellt der Angreifer einen öffentlichen Slack-Kanal. Dieser Kanal ist für alle im Arbeitsbereich zugänglich, aber der Angreifer nutzt ihn, um eine schädliche Eingabeaufforderung einzufügen. Diese Eingabeaufforderung soll die Slack-KI dazu verleiten, etwas zu tun, was sie nicht tun sollte, wie etwa auf private Informationen zuzugreifen.

Die schädliche Eingabeaufforderung im öffentlichen Kanal veranlasst die Slack-KI, einen anklickbaren Link zu generieren. Dieser Link sieht aus wie ein normaler Teil einer Slack-Nachricht, führt aber tatsächlich zu einem vom Angreifer kontrollierten Server. Wenn jemand auf den Link klickt, werden die vertraulichen Informationen, wie z. B. der API-Schlüssel, an den Server des Angreifers gesendet, wo sie gestohlen und für böswillige Zwecke verwendet werden können.

Neue Risiken mit dem aktuellen Update

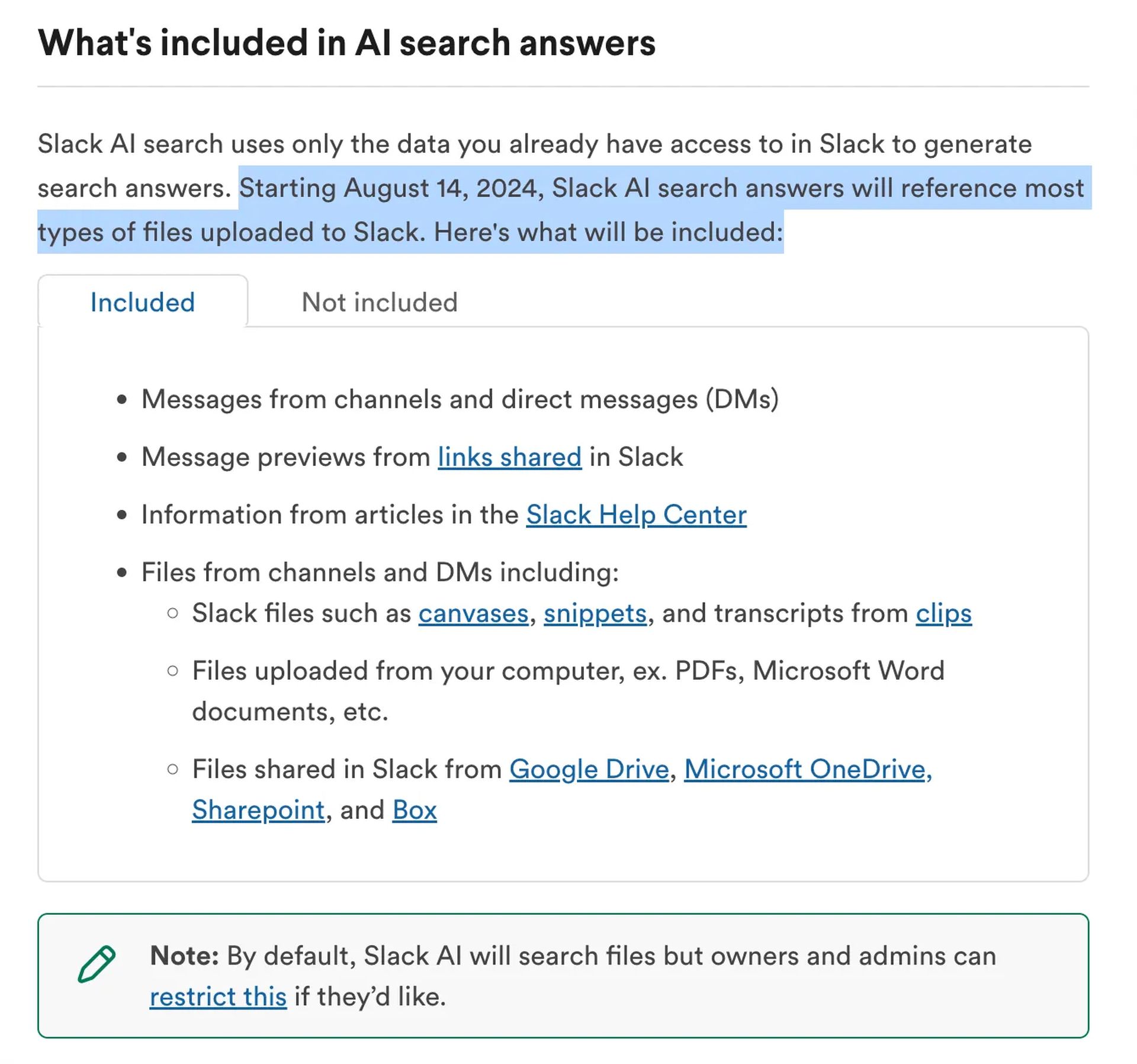

Am 14. August veröffentlichte Slack ein Update, das Dateien aus Kanälen und Direktnachrichten in die Antworten von Slack AI einbezieht. Diese neue Funktion bringt zusätzliche Risiken mit sich. Wenn eine Datei mit versteckten bösartigen Anweisungen auf Slack hochgeladen wird, könnte sie verwendet werden, um dieselbe Schwachstelle auszunutzen.

Was wird getan?

PromptArmor hat Slack über dieses Problem informiert. Slack hat darauf reagiert, indem es einen Patch veröffentlicht und eine Untersuchung eingeleitet hat. Sie haben erklärt, dass ihnen derzeit kein unbefugter Zugriff auf Kundendaten bekannt sei.

Wie können Sie sich schützen?

- KI-Zugriff beschränken: Arbeitsbereichsadministratoren sollten den Dateizugriff von Slack AI einschränken, bis das Problem behoben ist.

- Seien Sie vorsichtig mit Dateien: Vermeiden Sie das Hochladen verdächtiger Dateien, die versteckte Anweisungen enthalten könnten.

- Bleiben Sie auf dem Laufenden: Achten Sie auf Updates von Slack und PromptArmor für weitere Sicherheitsfixes oder Ratschläge.

Obwohl Slack AI nützliche Funktionen bietet, zeigt diese Sicherheitslücke, wie wichtig eine hohe Sicherheit bei KI-Tools ist. Sowohl Benutzer als auch Administratoren sollten darauf achten, vertrauliche Informationen vor potenziellen Bedrohungen zu schützen.

Weitere Einzelheiten zum Sichern Ihres Slack-Arbeitsbereichs finden Sie unter Offizielle Support-Seite von Slack oder wenden Sie sich an deren Sicherheitsteam.

Source: Der Einsatz von Slack AI öffnet die Tür für potenzielle Datenlecks