Nvidia Corp. stellte einen verbesserten KI-Prozessor vor, der die Kapazität und Leistung des Chips steigert und damit die Vormachtstellung des Unternehmens in einem wachsenden Bereich festigen soll. NVIDIA GH200 Grace Hopper wird im zweiten Quartal 2024 verfügbar sein.

Nvidia sagte am Dienstag auf der Siggraph-Konferenz in Los Angeles, dass der Grace Hopper Superchip, ein Hybrid aus Grafikchip und CPU, von einer neuen Speicherform profitieren wird. Das Gerät basiert auf dem High-Bandwidth-Speicher 3 oder HBM3e, der mit unglaublichen 5 Gigabyte pro Sekunde auf Daten zugreifen kann.

Die neueste Ankündigung von Nvidia folgt auf die zuvor angekündigte GH200 mit HBM3, die sich derzeit in Produktion befindet und noch in diesem Jahr erhältlich sein wird. Dies bedeutet, dass NVIDIA zwei Versionen desselben Geräts produzieren wird, die erste mit HBM3 und die zweite mit HBM3e. Nvidia sagt außerdem, dass die GH200 der nächsten Generation dank HBM3e-Speicher KI-Modelle 3,5-mal schneller ausführen kann als das aktuelle Modell.

Nvidia GH200 Grace Hopper: Basierend auf einer Grace-CPU mit 72 Kernen

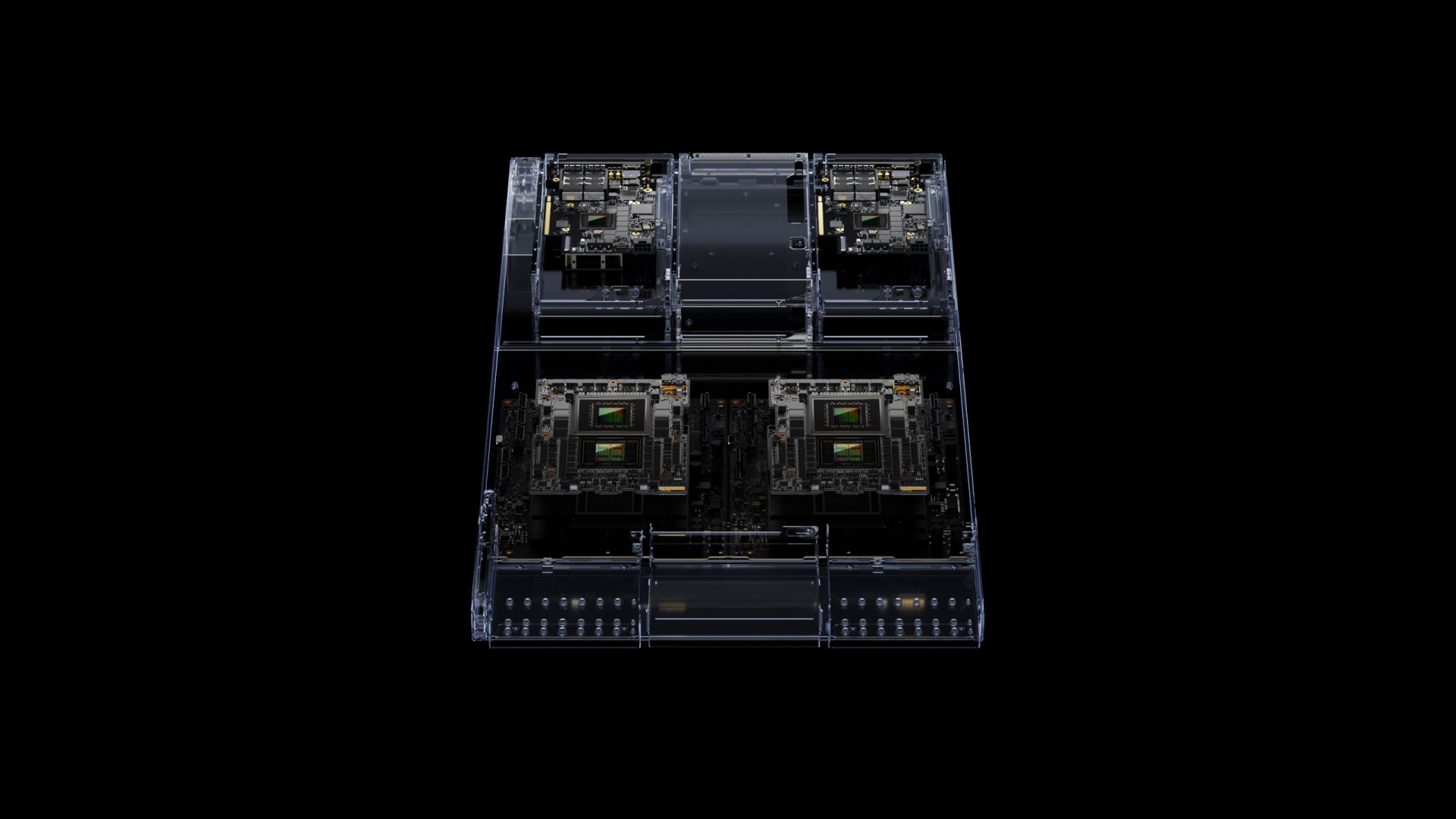

Der neue GH200 Grace Hopper Superchip basiert auf einer 72-Kern-Grace-CPU mit 480 GB ECC LPDDR5X-Speicher und einer GH100-Rechen-GPU mit 141 GB HBM3E-Speicher in sechs 24-GB-Stacks und einer Speicherschnittstelle mit einer Breite von 6.144 Bit. NVIDIA verbaut physisch 144 GB Arbeitsspeicher, allerdings stehen für höhere Erträge nur 141 GB zur Verfügung.

NVIDIAs aktueller GH200 Grace Hopper Superchip verfügt über 96 GB HBM3-Speicher mit einer Bandbreite von weniger als 4 TB/s. Im Vergleich dazu steigert das neue Modell die Speicherkapazität um rund die Hälfte und die Bandbreite um mehr als ein Viertel. Solche großen Verbesserungen ermöglichen es der neuen Plattform, größere KI-Modelle als die vorherige Iteration auszuführen, was zu erheblichen Leistungssteigerungen führt.

Microsoft und NVIDIA unterzeichnen einen Deal Game Pass für Nvidia GeForce Now

Nvidia behauptet, dass dies auf unterschiedliche Konfigurationen derselben Komponente zurückzuführen sei, ähnlich wie bei den 40-GB- und 80-GB-Versionen des A100 von vor einigen Jahren. Tatsächlich ist hier zumindest vorerst die RAM-Auslastung der Hauptunterschied. Anstelle der 96 GB HBM3 vRAM und 480 GB LPDDR5x DRAM der aktuellen GH200-Generation verfügt die „nächste Generation“ GH200 über 141 GB HBM3e und 500 GB langsameres 400 GB/s LPDDR5x. In der vorherigen Iteration wurde LPDDR5x DRAM mit 512 GB/s verwendet.

Nvidia arbeitet schon seit einiger Zeit an Grace Hopper Superchips

Spätestens seit 2021, als das Unternehmen vorläufige Pläne bekannt gab, sind die Grace Hopper Superchips ein heißes Thema für den CEO von Nvidia.

Der Superchip basiert auf der Arm-Architektur, die häufig in Mobilgeräten verwendet wird und mit der x86-basierten Technologie von Intel und AMD konkurriert. Er wird von Nvidia als „Superchip“ bezeichnet, da er die Arm-basierte Nvidia Grace-CPU mit der Hopper-GPU-Architektur kombiniert.

Der Grace Hopper Superchip erhält einen Schub durch den weltweit schnellsten Speicher, HBM3e, in der neuesten Version des Nvidia GH200 Grace Hopper. Laut Nvidia ist der HBM3e-Speicher bis zu 50 % schneller als die HBM3-Technologie, die in der aktuellen Iteration des GH200 enthalten ist.

Nvidia Computex 2023 bringt die Zukunft des Gamings

„Wir sind sehr begeistert von dieser neuen GH200. Es wird über 141 Gigabyte HBM3e-Speicher verfügen. „HBM3e erhöht nicht nur die Kapazität und Menge des an unsere GPUs angeschlossenen Speichers, sondern ist auch viel schneller“, sagte Ian Buck, VP und General Manager für Hyperscale und HPC bei Nvidia, während eines Treffens mit Presse und Analysten Venture Beat.

Nvidia entwickelt nicht nur schnellere Hardware, sondern skaliert diese auch in einem neuen Serverdesign.

Buck gab an, dass Nvidia an einem neuen Dual-GH200-basierten Nvidia MGX-Serversystem arbeitet, das über zwei Grace Hopper Superchips der nächsten Generation verfügen soll. Er fuhr fort, dass die neue GH200 über NVLink, die Verbindungstechnologie von Nvidia, verbunden werde.

Dank NVLink werden sowohl CPUs als auch GPUs im neuen Dual-GH200-Server mit einer vollständig kohärenten Speicheranbindung gekoppelt.

Erscheinungsdatum der Nvidia GH200 Grace Hopper

Laut NVIDIA ist die GH200 Grace Hopper-Plattform mit HBM3 jetzt in Produktion und wird nächsten Monat im Handel erhältlich sein. Im Gegensatz dazu befindet sich die GH200 Grace Hopper-Plattform mit HBM3e derzeit in der Bemusterung und wird voraussichtlich im zweiten Quartal 2024 einsatzbereit sein.

Der neue GH200 Grace Hopper nutzt laut NVIDIA die gleiche Grace-CPU- und GH100-GPU-Technologie wie die vorherige Version, sodass keine weiteren Modifikationen oder Schritte erforderlich sind.

Hervorgehobener Bildnachweis: Nvidia

Source: Hier ist der neue Nvidia GH200 Grace Hopper