In Zusammenarbeit mit EleutherAI, LAION und StabilityAI wurde ein maschinelles Text-zu-Bild-Lernmodell namens Stable Diffusion AI Art Generator entwickelt, um digitale Bilder aus Beschreibungen in natürlicher Sprache zu generieren.

Die Schaffung von Kunst durch KI ist nicht neu. Software wie DALL-E 2, Midjourney AI und Stable Diffusion, die dieses Jahr eingeführt wurden, haben es jedoch selbst den am wenigsten erfahrenen Künstlern ermöglicht, komplexe, abstrakte oder lebensechte Kunstwerke zu erstellen, indem sie einfach ein paar Wörter in ein Textfeld eingeben.

Das Open-Source-Bilderzeugungsmodell von Stability AI ist qualitativ auf Augenhöhe mit DALL-E 2. Darüber hinaus wurde DreamStudio eingeführt, eine kommerzielle Website, die Rechenzeit für die Erstellung von Stable Diffusion-Images bereitstellt. Stable Diffusion kann im Gegensatz zu DALL-E 2 von jedem verwendet werden, und da der Code Open Source ist, können Projekte mit geringen Einschränkungen darauf aufbauen.

Was ist der Kunstgenerator Stable Diffusion AI?

Stability AI startete am 22. August Stable Diffusion, einen Open-Source-KI-Kunstgenerator. Python wird verwendet, um Stable Diffusion zu erstellen, und das Transformer-Sprachkonzept wird verwendet. Jedes Betriebssystem, das Cuda-Kernel unterstützt, kann es verwenden.

Dank des Open-Source-Bildsyntheseparadigmas Stable Diffusion kann jeder mit einem PC und einer guten GPU nahezu jede visuelle Realität erstellen, die er sich vorstellen kann. Es kann praktisch jeden visuellen Stil duplizieren, wenn Sie ihm einen beschreibenden Text geben, und die Ergebnisse erscheinen auf wundersame Weise auf Ihrem Bildschirm.

Im Gegensatz zu Methoden wie DALL-E stellt Stable Diffusion seinen Quellcode zur Verfügung. Die Lizenz verbietet einige riskante Nutzungssituationen.

Die KI-Ethik wird von Gegnern angegriffen, die behaupten, dass das Modell verwendet werden kann, um „Deepfakes“ zu erstellen, und in Frage stellen, ob es angemessen ist, Bilder mit einem Modell zu erstellen, das auf einem Datensatz trainiert wurde, der urheberrechtlich geschützte Inhalte ohne Zustimmung der Künstler enthält.

Der Trainingssatz für Stable Diffusion war ein Teilsatz des LAION-Aesthetics V2-Datensatzes. Es wurde auf 256 Nvidia A100-GPUs im Einkaufsmodus für 600.000 US-Dollar trainiert.

Stability AI, das Unternehmen, das Stable Diffusion untermauert, befindet sich in Gesprächen, um Kapital mit einer Bewertung von bis zu 1 Milliarde US-Dollar ab September 2022 zu suchen.

Stable Diffusion-Download-Anforderungen

Im Jahr 2022 wird ein typischer Gaming-PC Stable Diffusion unterstützen, Ihr Telefon und die meisten Laptops jedoch nicht. Die Voraussetzungen für den Download von Stable Diffusion, die Sie erfüllen müssen, lauten wie folgt:

- Eine GPU mit at am wenigsten 6 Gigabyte (GB) VRAM

- Dazu gehören die meisten modernen NVIDIA-GPUs

- 10 GB (ish) Speicherplatz auf Ihrer Festplatte oder Ihrem Solid-State-Laufwerk

- Das Miniconda3-Installationsprogramm

- Die Stable Diffusion-Dateien von GitHub

- The Latest Checkpoints (Version 1.4, zum Zeitpunkt des Schreibens, aber 1.5 sollte bald veröffentlicht werden)

- Der Git-Installer

- Windows 8, 10 oder 11

- Stable Diffusion kann auch unter Linux und macOS ausgeführt werden

Wie groß ist der Kunstgenerator Stable Diffusion AI?

Sie benötigen ungefähr 10 GB Speicherplatz auf Ihrer Festplatte oder Ihrem Solid-State-Laufwerk.

Sie können verwenden Midjourney-KI oder andere webbasierte KI-Generatoren, wenn Sie nicht über die erforderliche Hardware verfügen.

Wie führe ich den Kunstgenerator Stable Diffusion AI aus?

Dies sind die Schritte zum Ausführen des Stable Diffusion AI-Kunstgenerators:

- Installieren Git

- Installieren Miniconda3

- Laden Sie die herunter Stable Diffusion GitHub-Repository und die Letzter Kontrollpunkt

Lassen Sie uns einen genaueren Blick darauf werfen, wie Sie sie ausführen können.

Installieren Sie Git

Programmierer können mehrere Versionen der Software, die sie entwickeln, mit Hilfe der Technologie namens Git verwalten. Sie können verschiedene Versionen der Software, an der sie arbeiten, in einem gemeinsam genutzten Repository aufbewahren und gleichzeitig anderen Entwicklern erlauben, zum Projekt beizutragen.

Wenn Sie kein Entwickler sind, bietet Ihnen Git eine einfache Möglichkeit, auf diese Projekte zuzugreifen und sie herunterzuladen. Wir werden es in diesem Fall anwenden. Laufen die Windows x64-Installationsprogramm das von der Git-Website bezogen werden kann, ist für die Installation von Git erforderlich.

Sie haben die Möglichkeit, während der Installation mehrere Optionen festzulegen; belassen Sie sie alle auf ihren Standardeinstellungen. Es ist wichtig, die Optionsseite „Adjusting Your PATH Environment“ zu besuchen. Nur „Git From The Command Line And Also From 3rd-Party Software“ sollte ausgewählt werden.

Miniconda3 installieren

Stable Diffusion verwendet eine Vielzahl von Python-Bibliotheken. Wenn Sie mit Python nicht vertraut sind, machen Sie sich darüber keine allzu großen Sorgen; Es genügt zu verstehen, dass Bibliotheken nur Softwarepakete sind, die Ihr Computer verwenden kann, um bestimmte Aufgaben auszuführen, wie z. B. das Bearbeiten eines Bildes oder das Ausführen anspruchsvoller Arithmetik.

Miniconda3 ist im Wesentlichen ein Convenience-Tool. Es ermöglicht Ihnen, jede für Stable Diffusion erforderliche Bibliothek ohne mühsame Arbeit zu verwalten. Es wird sich auch darauf auswirken, wie wir die stabile Diffusion in realen Szenarien verwenden.

Besuche den Miniconda3-Download-Seite und wählen Sie „Miniconda3 Windows 64-Bit“, um die neueste Version zu erhalten.

Durch Doppelklicken auf die ausführbare Datei nach dem Herunterladen wird die Installation gestartet. Im Vergleich zu Git erfordert die Installation von Miniconda3 weniger Seitenklicks. Bei dieser Entscheidung sollten Sie jedoch Vorsicht walten lassen:

Stellen Sie sicher, dass „Alle Benutzer“ ausgewählt ist, bevor Sie die Schaltfläche „Weiter“ drücken und die Installation abschließen.

Nach der Installation von Miniconda3 und Git werden Sie aufgefordert, Ihren Computer neu zu starten.

Laden Sie das Stable Diffusion GitHub-Repository und den neuesten Checkpoint herunter

Nach der Installation der erforderlichen Software können wir Stable Diffusion herunterladen und einrichten.

Herunterladen der Letzter Kontrollpunkt sollte zuerst kommen. Um den Checkpoint herunterzuladen, müssen Sie zuerst ein Konto erstellen, aber alles, was sie benötigen, ist Ihr Name und Ihre E-Mail-Adresse.

Der Link mit der Aufschrift „sd-v1-4.ckpt“ startet den Download. Die andere Datei „sd-v1-4-full-ema.ckpt“ ist fast doppelt so groß, liefert aber möglicherweise bessere Ergebnisse. Sie können beide verwenden.

Der nächste Schritt ist zu erhalten Stabile Diffusion von GitHub. Wählen Sie die grüne Schaltfläche „Code“ und klicken Sie dann auf „ZIP herunterladen“. Sie können verwenden diesen direkten Download-Link auch.

Nachdem wir die Dateien für Stable Diffusion entpackt haben, müssen wir einige Verzeichnisse erstellen, um sie zu entpacken. Klicken Sie auf die Schaltfläche Start, geben Sie „miniconda3“ in das Suchfeld des Startmenüs ein und wählen Sie dann „Öffnen“ oder „Eingabe“.

Wir erstellen über die Befehlszeile einen Ordner namens „stable-diffusion“. Nachdem Sie den nächsten Codeabschnitt in das Miniconda3-Feld eingefügt haben, drücken Sie die Eingabetaste.

Wenn alles wie geplant läuft, erscheint das Miniconda3-Fenster. Lassen Sie Miniconda3 geöffnet, da wir es in Kürze wieder benötigen.

Verwenden Sie Ihren bevorzugten Dateiarchivierer, um das ZIP-Archiv „stable-diffusion-main.zip“ zu öffnen, das Sie von GitHub heruntergeladen haben. Windows kann ZIP-Dateien alternativ selbst öffnen, wenn Sie keine haben. Während Sie die ZIP-Datei im ersten Datei-Explorer-Fenster geöffnet lassen, öffnen Sie ein zweites Fenster und navigieren Sie zum gerade erstellten Ordner „C:stable-diffusion“.

Ziehen Sie den Ordner „stable-diffusion-main“ per Drag & Drop in den Ordner „stable-diffusion“ aus dem ZIP-Archiv.

Gehen Sie zurück zu Miniconda3 und fügen Sie die folgenden Befehle in das Fenster ein:

cd C:stable-diffusionstable-diffusion-main conda env create -f environment.yaml conda activate ldm mkdir modelsldmstable-diffusion-v1

Fahren Sie mit dem Verfahren fort. Da einige Dateien mehr als ein Gigabit groß sind, kann das Herunterladen einige Zeit dauern. Wenn Sie den Vorgang versehentlich unterbrechen, müssen Sie den Umgebungsordner löschen und conda env create -f environment.yaml neu starten. Führen Sie in diesem Szenario nach dem Löschen des Ordners „ldm“ aus „C:Users(Your User Account).condaenvs“ den vorherigen Befehl aus.

Der letzte Schritt der Installation ist nun abgeschlossen. Kopieren Sie mithilfe des Datei-Explorers die Checkpoint-Datei (sd-v1-4.ckpt) und fügen Sie sie in den Ordner „C:stable-diffusionstable-diffusion-mainmodelsldmstable-diffusion-v1“ ein.

Klicken Sie mit der rechten Maustaste auf „sd-v1-4.ckpt“, nachdem die Datei übertragen wurde, und wählen Sie „Umbenennen“ aus dem Kontextmenü. Geben Sie „model.ckpt“ in das hervorgehobene Feld ein und drücken Sie die Eingabetaste, um die Datei umzubenennen.

Damit sind wir jetzt fertig. Stabile Diffusion steht jetzt zur Verfügung. Doch wie?

Stable Diffusion Anleitung: Wie verwende ich den Stable Diffusion AI Art Generator?

Wie funktioniert Stable Diffusion? Befolgen Sie diese Schritte, um den Stable Diffusion AI Art Generator optimal zu nutzen:

- Aktivieren Sie die ldm-Umgebung

- Ändern Sie das Verzeichnis

- Verwenden Sie txt2img.py und schreiben Sie Ihren Text

- Warten Sie auf den Vorgang

- Überprüfen Sie die Ergebnisse

Jedes Mal, wenn Sie stabile Diffusion verwenden möchten, müssen Sie die von uns entworfene ldm-Umgebung aktivieren. Geben Sie conda activate ldm in das Miniconda3-Fenster ein und drücken Sie „Enter“. Eine aktive ldm-Umgebung wird durch das (ldm) auf der linken Seite angezeigt.

Wir müssen zuerst das Verzeichnis (also die Befehls-CD) auf „C:stable-diffusionstable-diffusion-main“ ändern, bevor wir irgendwelche Fotos erstellen können. Fügen Sie den Befehlszeilenparameter cd C:stable-diffusionstable-diffusion-main hinzu.

Wir werden Textaufforderungen mit einem Tool namens txt2img.py in 512512-Visuals konvertieren.

Während die Fotos erstellt werden, sehen Sie auf Ihrer Konsole einen Fortschrittsbalken.

„C:stable-diffusionstable-diffusion-mainoutputstxt2img-samplesamples“ ist der Speicherort aller produzierten Bilder.

Beispiele und Eingabeaufforderungen für stabile Diffusion

Im Folgenden sind einige der besten Beispiele für Stable Diffusion AI-Kunstgeneratoren und ihre Eingabeaufforderungen aufgeführt:

Prompt: Forest Wanderer von Dominic Mayer, Anthony Jones, Loish, malerischer Stil von Gerald Parel, Craig Mullins, Marc Simonetti, Mike Mignola, flache Farbillustration, hell und farbenfroh, hoher Kontrast, Mythologie, filmisch, detailliert, atmosphärisch, episch, Konzeptkunst, Mattmalerei, Herr der Ringe, Game of Thrones, Lichtstrahlen, Nebel, , fotorealistisch, Konzeptkunst, volumetrisches Licht, filmisches Epos + Drittelregel | 35mm| Oktan-Rendering, 8k, Korona-Rendering, Filmkonzeptkunst, Oktan-Rendering, 8k, Korona-Rendering, filmisch, Trend auf Artstation, Filmkonzeptkunst, Filmkomposition, ultradetailliert, realistisch, hiperrealistisch, volumetrische Beleuchtung, 8k –ar 3:1 – Test – Uplight

Prompt: Umgebung Schloss Nathria in World of Warcraft: voll ausgebautes Schloss im gotischen Stil: filmisch, Regen, Nacht, detailliert, episch, Konzeptkunst, matte Malerei, Lichtschächte, Nebel, fotorealistisch, Konzeptkunst, volumetrisches Licht, filmisches Epos + Regel von Dritteln, Filmkonzeptkunst, 8k, filmisch, im Trend auf Artstation, Filmkonzeptkunst, Filmkomposition, ultradetailliert, realistisch, hyperrealistisch, volumetrische Beleuchtung, 8k –ar 3:1

Prompt: klares Porträt eines Superheldenkonzepts zwischen Spiderman und Batman, Cottagecore!!, Hintergrund hyperdetailliert, Charakterkonzept, Ganzkörper, dynamische Pose, kompliziert, hochdetailliert, digitale Malerei, Artstation, Konzeptkunst, glatt, scharfer Fokus, Illustration, Kunst von Artgerm und Greg Rutkowski und Alphonse Mucha

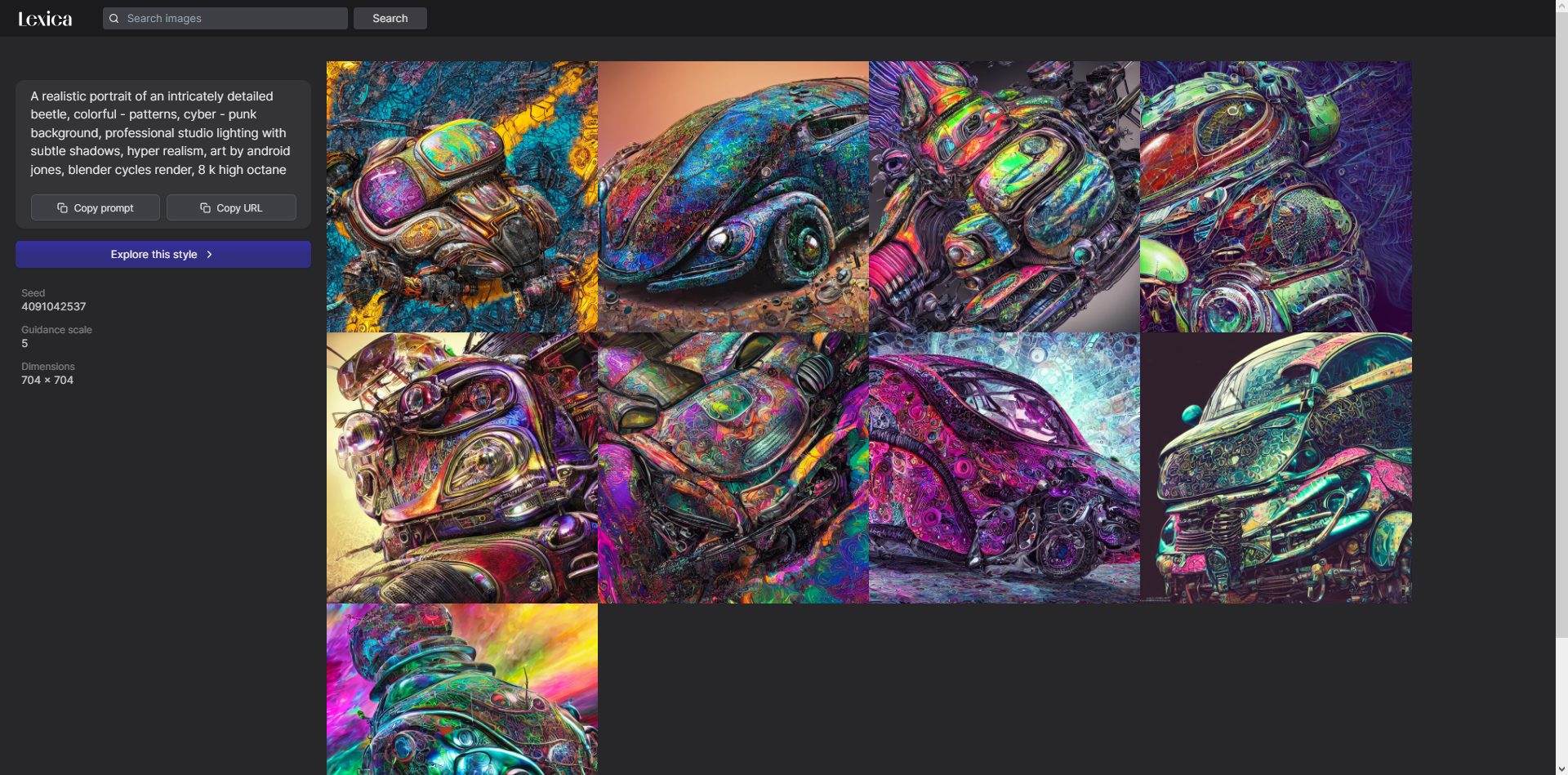

Was ist Lexica Art?

Lexica ist eine Galerie und Suchmaschine für Kunst, die mit Stable Diffusion erstellt wurde.

Du kannst nachschauen Lexika, eine Website für eine Suchmaschine, die KI-generierte Bilder aus stabiler Verbreitung verwendet. Lexica enthält Eingabeaufforderungen für automatisch generierte Bilder.

Ist Stable Diffusion Open Source?

Ja. Die in Stable Diffusion verwendeten Bilder, die am 22. August als Open Source veröffentlicht wurden, wurden von einem neuronalen Netzwerk erstellt, das mit Millionen von Bildern trainiert wurde, die aus dem Internet abgerufen wurden.

Für DALL-E und Midjourney AI ist kürzlich ein neuer Rivale aufgetaucht. Vor allem ist es kostenlos! Wir werden sehen, wie sich die Konflikte des KI-Kunstgenerators auf die Dinge auswirken.

Source: Stable Diffusion AI Art Generator: Eingabeaufforderungen, Beispiele und Ausführung