Künstliche Intelligenz (KI) hat in den letzten Jahren unglaubliche Fortschritte gemacht. Dennoch ist es für LLM-Entwickler immer noch ein fortlaufender Prozess, zu verstehen, was eine KI-Halluzination ist und wie man sie überwinden kann.

Die Technologie von heute und morgen fasziniert uns alle weiterhin, insbesondere wenn es darum geht, wie KI menschliche Sprache verstehen und erzeugen kann. Große Fortschritte wurden mit Large Language Models (LLMs) gemacht, Computerprogrammen, die auf riesigen Textmengen trainiert werden. Diese LLMs können verschiedene Arten kreativer Textformate schreiben, wie Gedichte, Code, Skripte, Musikstücke, E-Mails, Briefe usw.

Es gibt jedoch ein besonderes Problem bei der Kraft dieser beeindruckenden Modelle: Manchmal „halluzinieren“ sie.

Was ist eine KI-Halluzination?

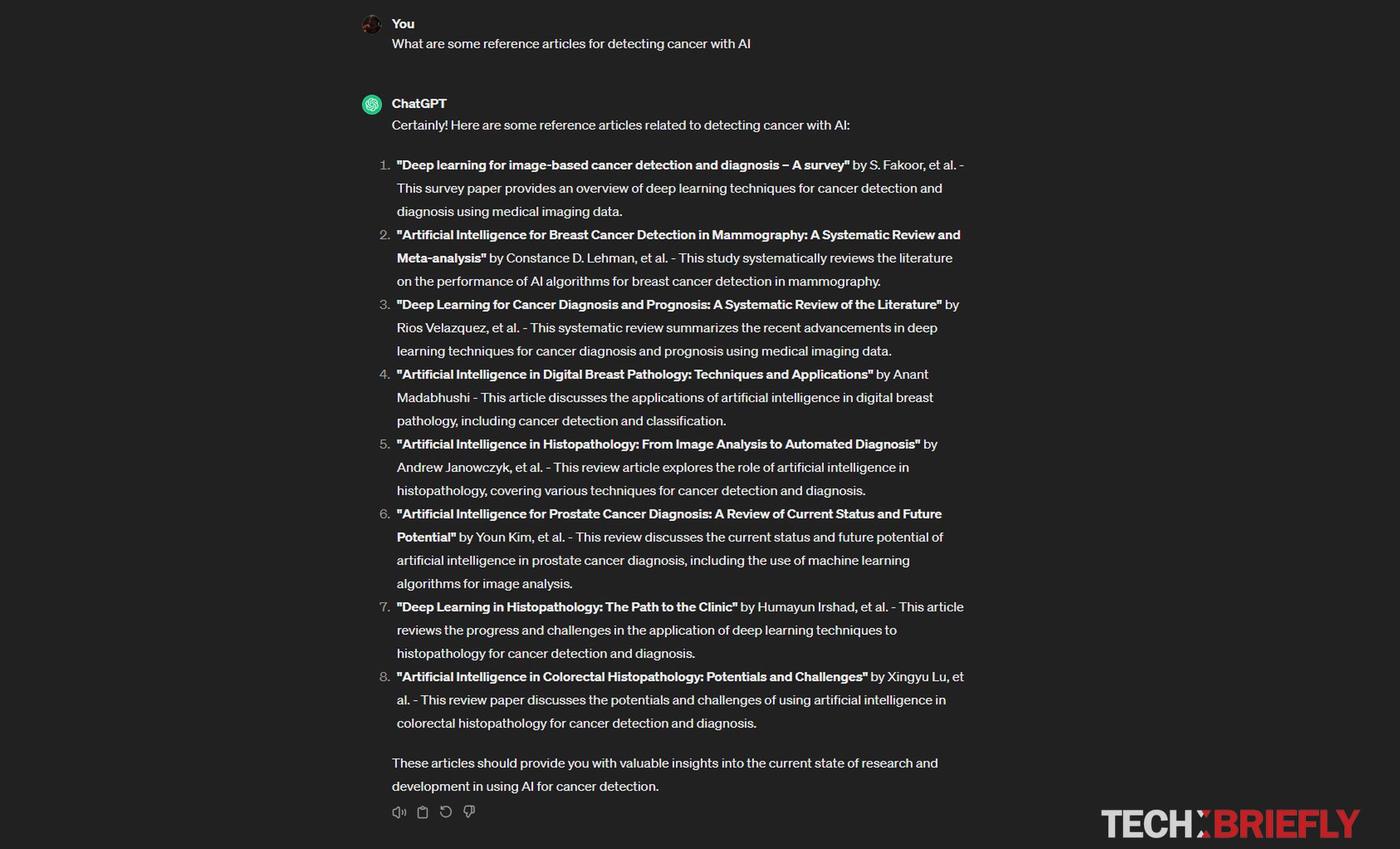

So wie Menschen sich Dinge vorstellen oder träumen können, die nicht real sind, kann KI etwas Ähnliches tun. KI-Halluzinationen treten auf, wenn ein LLM Text produziert, der glaubwürdig erscheint, aber sachlich falsch ist. Diese Halluzinationen können von geringfügigen Fehlern bis hin zu völlig erfundenen Geschichten und unsinnigen Aussagen reichen.

Um dieses Problem besser zu verstehen, schauen wir uns einige Beispiele an:

- Fakten vermischen: Eine KI, die gebeten wird, einen Nachrichtenartikel über ein Ereignis zu schreiben, könnte falsche Daten und Orte enthalten oder die beteiligten Personen falsch darstellen.

- Falsch erstellen Information: Eine KI, die mit dem Schreiben einer Produktbeschreibung beauftragt ist, könnte Funktionen erfinden, die das Produkt tatsächlich nicht hat.

- Mit Sicherheit falsch: Das wirklich Knifflige an KI-Halluzinationen ist, dass sie oft sehr überzeugend präsentiert werden, was es schwierig macht, sie von echten Informationen zu unterscheiden.

Warum sind Halluzinationen ein Problem für LLMs?

Wie Sie unseren Erläuterungen zu KI-Halluzinationen entnehmen können, stellen sie aus mehreren Gründen ein erhebliches Problem für LLMs dar. Erstens: Wenn Menschen dem von einem LLM generierten Text nicht vertrauen können, verlieren Benutzer das Vertrauen in den Gesamtnutzen und die Zuverlässigkeit der Technologie. Stellen Sie sich vor, Sie lesen online eine Zusammenfassung einer Nachrichtenmeldung, die von einem LLM verfasst wurde. Wenn die Zusammenfassung sachliche Fehler enthält, können Sie die Verwendung dieser Quelle möglicherweise ganz einstellen. Dies kann ein großes Problem für jede Anwendung sein, die auf LLMs zur Generierung von Text angewiesen ist, wie etwa Chatbots, virtuelle Assistenten oder automatisierte Tools zur Inhaltserstellung.

Zweitens könnten KI-Halluzinationen zur Verbreitung von Fehlinformationen beitragen. In einer Zeit, in der Fake News bereits ein großes Problem darstellen, kann KI-generierter Text, der glaubwürdig erscheint, leicht mit echten Informationen verwechselt werden. Dies könnte negative Auswirkungen auf alles haben, vom öffentlichen Diskurs bis hin zu wichtigen Entscheidungsprozessen. Stellen Sie sich zum Beispiel vor, ein LLM erstellt Social-Media-Beiträge über einen politischen Kandidaten, die falsche Informationen enthalten.

Diese Beiträge könnten Wähler irreführen und den Ausgang einer Wahl beeinflussen. Genau aus diesem Grund hat Google Geminis Fähigkeit deaktiviert, auf wahlbezogene Anfragen zu antworten.

Drittens könnten Unternehmen oder Organisationen, die LLMs nutzen, einen Reputationsschaden erleiden, wenn ihre KI-Systeme ungenaue oder schädliche Inhalte produzieren. Nehmen wir an, ein Unternehmen verwendet ein LLM, um Produktbeschreibungen für seinen Online-Shop zu schreiben. Wenn das LLM Funktionen erfindet, über die die Produkte eigentlich nicht verfügen, könnte dies zur Unzufriedenheit der Kunden führen und den Ruf des Unternehmens schädigen.

Warum kommt es zu KI-Halluzinationen?

Sie haben jetzt einige Vorstellungen darüber, was eine KI-Halluzination ist, aber warum passieren sie? Mehrere Faktoren tragen zu diesem Problem bei:

- Wie sie ausgebildet werden: LLMs werden mit enormen Mengen an Textdaten gefüttert. Diese Daten enthalten häufig Fehler, Verzerrungen und veraltete Informationen. Aus diesen Daten lernt die KI genauso wie aus korrekten Informationen.

- Verstehen vs. Schaffen: LLMs sind gut darin, Muster in der Sprache zu verstehen, aber sie haben nicht immer ein solides Verständnis für reale Konzepte oder Logik. Sie können etwas generieren, das plausibel klingt, ohne dass es tatsächlich wahr ist.

- Das Streben nach Geläufigkeit: LLMs sind darauf ausgelegt, Texte zu produzieren, die natürlich und menschenähnlich klingen. Manchmal bedeutet dies, „die Lücken zu füllen“, wo es Lücken im Wissen der KI geben könnte. Diese ausgefüllten Lücken können dazu führen, dass die KI Inhalte erstellt.

Was wird getan, um das Problem zu lösen?

Forscher und Entwickler in der KI-Community arbeiten aktiv an Möglichkeiten, KI-Halluzinationen zu reduzieren.

Einige der Ansätze umfassen:

- Bessere Trainingsdaten: Erstellen sorgfältig kuratierter Datensätze, die weniger wahrscheinlich Fehler und Verzerrungen enthalten, was zu einem verbesserten KI-Verhalten führt.

- Fakten Überprüfung: Entwicklung von Techniken zum Querverweisen von KI-generiertem Text mit zuverlässigen Quellen, um dessen Genauigkeit sicherzustellen.

- Erklärbarkeit: Entwerfen von LLMs, die ihren Argumentationsprozess erklären können, was es einfacher macht, potenzielle Fehler zu erkennen

- Zusammenarbeit zwischen Mensch und KI: Aufbau von Systemen, in denen Menschen und KI zusammenarbeiten, um Halluzinationen leichter zu erkennen und zu korrigieren.

Darüber hinaus gibt Jensen Huang von Nvidia an, dass KI-Halluzinationen innerhalb der nächsten fünf Jahre geheilt werden können.

KI-Halluzinationen sind also eine komplexe Herausforderung, aber es ist eine entscheidende Herausforderung, die es zu bewältigen gilt, wenn LLMs ihr volles Potenzial ausschöpfen wollen. Da Technologien zur Reduzierung von Halluzinationen immer ausgefeilter werden, versprechen sie, LLMs zu einem viel vertrauenswürdigeren und wertvolleren Werkzeug für Kommunikations-, Kreativitäts- und Wissensaufgaben zu machen.

Hervorgehobener Bildnachweis: vackground.com/Unsplash

Source: Was ist eine KI-Halluzination und warum ist sie eine große Sache für die Zukunft von LLMs?